KI aus der Praxis: Engineering-Copilot

In Projekten mit unseren Kunden begegnet uns immer wieder dasselbe Muster. Unternehmen verfügen über internes Wissen in Form von Checklisten, Präsentationen, Workshop-Protokollen und Projekterfahrungen aus der Vergangenheit. Gleichzeitig wächst die Menge relevanter Fachliteratur, die in der täglichen Projektarbeit kaum systematisch genutzt werden kann. Die Frage ist selten, ob das Wissen vorhanden ist. Die Frage ist vielmehr, wie es schneller und konsistenter verfügbar gemacht werden kann. Gemeinsam mit unseren Kunden entwickeln wir KI-gestützte Lösungen, die genau das adressieren und zeigen, dass gute KI-Lösungen nicht immer aufwändig sein müssen.

Das Prinzip: Kontext schlägt Modell

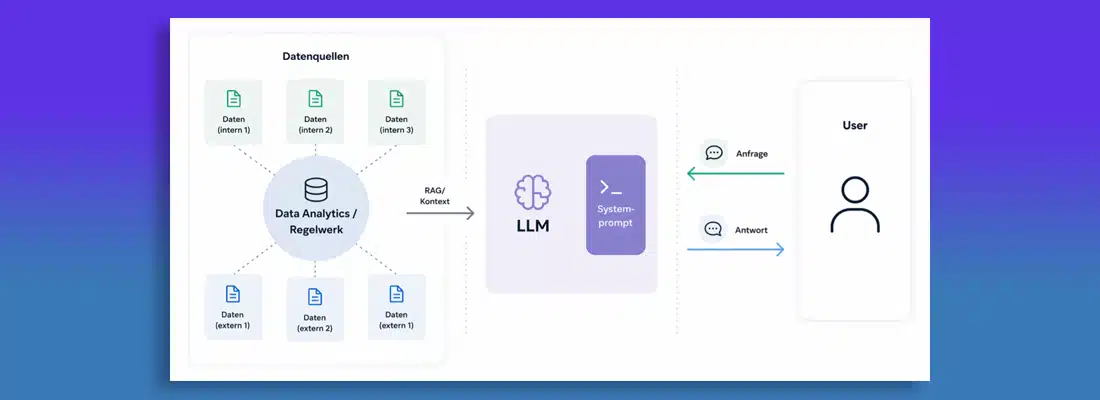

Standardsprachmodelle und Chatbots wie GPT, Gemini oder Claude sind leistungsstarke Werkzeuge, bleiben als reine Chatbots aber oftmals zu generisch. Sie sind inzwischen durch verschiedene Tool-Calls nah am Wissen von Experten, aber bei Spezialthemen fehlt die Tiefe und interne Prozesse sind nicht bekannt. Der entscheidende Hebel ist deshalb nicht das Modell selbst, sondern der Kontext, der ihm mitgegeben wird. Die Architektur für Speziallösungen dahinter ist im Kern konzeptuell einfach erklärbar. Interne und externe Wissensquellen werden aufbereitet und dem Modell entweder direkt oder über RAG (Retrieval-Augmented Generation) bereitgestellt. Ein präziser System-Prompt definiert das Verhalten, die Fachsprache und das Ausgabeformat der Lösung. Das Ergebnis ist ein System, das nicht nur Wissen abruft, sondern durch die Generalisierungsfähigkeit des LLMs bekannte Lösungsmuster auf neue Problemstellungen überträgt und direkt anwendbare Empfehlungen generiert.

Entscheidend ist dabei, dass die Qualität der Lösung primär von der Güte der Wissensbasis und des Prompts abhängt und nicht vom gewählten Modell. Ob die Lösung als Custom GPT bei OpenAI, als Gem in Google (Gemini) oder als Projekt in Claude eingesetzt wird, spielt dabei eine untergeordnete Rolle. Das Grundprinzip und die erzielbare Ergebnisqualität sind über alle Plattformen übertragbar.

Mehr als Wissensabruf

Der Unterschied zu einem generischen Chatbot liegt nicht im Modell, sondern im Kontext. Wenn interne Methoden, historische Projektdaten, unternehmensspezifische Checklisten und externe Fachquellen systematisch aufbereitet und mit einem durchdachten Prompt kombiniert werden, entsteht ein System, das die Sprache des Unternehmens spricht. Es kennt die internen Definitionen, orientiert sich an etablierten Prozessen und gibt Empfehlungen, die in der Praxis direkt anwendbar sind.

In einem konkreten Engineering-Projekt wurde ein solcher Copilot entwickelt, der Ingenieure bei der strukturierten Analyse und Lösungsfindung unterstützt. Als Wissensbasis dienten sowohl interne Dokumente wie Methoden-Guidelines, projektspezifische Checklisten und Projekterfahrungen als auch externe Fachquellen wie wissenschaftliche Publikationen und etablierte Konstruktionsprinzipien. Das System synthetisiert diese Quellen, analysiert neue Problemstellungen und schlägt priorisierte Lösungsansätze in Sekunden vor, wo Experten sonst Stunden benötigen würden.

Besonders relevant ist, dass das System nicht nur Wissensabruf betreibt, sondern einen echten inhaltlichen Transfer leistet. Es erkennt Muster aus vergangenen Projekten und überträgt sie auf neue Situationen, ähnlich wie ein erfahrener Kollege, der gesammelte Erfahrungen gezielt anwendet.

Nutzerakzeptanz durch Vertrautheit

Ein oft unterschätzter Erfolgsfaktor bei der Einführung von KI-Lösungen ist die Nutzerakzeptanz. Ergebnisse, die generisch klingen oder nicht zur internen Sprache und Methodik passen, stoßen auf Skepsis, unabhängig davon, wie gut das zugrunde liegende Modell ist. Anders verhält es sich, wenn ein Ergebnis so strukturiert ist wie ein bekanntes internes Dokument, die gewohnte Fachterminologie verwendet und sich an internen Bewertungskriterien orientiert.

Wer eine Antwort erhält, die klingt, als hätte ein erfahrener Kollege mit vollständigem Überblick über alle Unternehmensrichtlinien sie verfasst, vertraut dem Ergebnis eher und setzt es leichter in die Praxis um. Durch die Überführung interner Definitionen, Prozesse und Bewertungsmaßstäbe in die Wissensbasis und den System-Prompt entsteht eine Lösung, die inhaltlich passt und im Arbeitsalltag akzeptiert wird.

Schnell starten, gezielt skalieren

Ein wesentlicher Vorteil dieses Ansatzes ist seine Skalierbarkeit. Ein erster funktionsfähiger Pilot lässt sich in vergleichsweiser kurzer Zeit mit einer strukturierten Wissensbasis, einem guten Prompt und einem leistungsfähigen LLM entwickeln. Wenn der Pilot überzeugt, kann die Lösung schrittweise ausgebaut werden, z.B. durch die Einbindung dynamischer Daten, größerer Datenbanken, weiterer interner Quellen oder angepasster Ausgabeformate. Auch komplexere Visualisierungen oder die Integration in bestehende Systeme sind möglich.

Solche Lösungen stellen einen effektiven Weg dar, schnell einen konkreten KI-Mehrwert zu schaffen, ohne aufwändige Infrastruktur und ohne eigene Modellentwicklung. Entscheidend sind die Qualität der Wissensgrundlage und das Prompt-Design. Wer das Prinzip einmal erfolgreich angewendet hat, kann es auf weitere Fachbereiche, Methoden oder Fragestellungen übertragen. Kommen Sie bei Fragen für Ihre internen Prozesse gerne auf uns zu.

Bild: © TIM Consulting

M.Sc. Marius Heil

DAS KÖNNTE SIE NOCH INTERESSIEREN …

CumulusAI: Einladung zum Live-Webinar am 23.04.26, 16:00

Treffen Sie bessere Entscheidungen schneller – mit KI-gestützter Technologieanalyse von CumulusAI.

AI Culture: KI und Unternehmenskultur

Mit KI verändern sich Prozesse, Entscheidungswege und Führungsverständnis – Kultur wird zum Erfolgsfaktor.

Entdecken Sie CumulusAI – kostenloses Live-Webinar am 12.03.26, 16:00

Entdecken Sie, wie unsere KI-Software CumulusAI Ihre Innovations-, Strategie- und Produktentscheidungen revolutioniert!